Une étude de l'université de Fudan, en Chine, a révélé que deux grands modèles de langage (LLM) populaires sont parvenus à se répliquer sans intervention humaine, franchissant ainsi une « ligne rouge » critique dans l'évolution de l'intelligence artificielle (IA). D'après les chercheurs, la capacité de ses modèles d'IA d'avant garde à créer des répliques d'eux mêmes s'expliquerait par leurs aptitudes d'auto-perception, de conscience de la situation et de résolution de problèmes.Cette récent

Get Started for FREE

Sign up with Facebook Sign up with X

I don't have a Facebook or a X account

|

Going social

Blogs, curation, médias sociaux, SEO, identité numérique : notre vie sur la toile ! Curated by Marco Bertolini |

Your new post is loading...

Your new post is loading...

|

Scooped by

Marco Bertolini

Today, 3:53 AM

|

- Nuestros clics son una acción política cotidiana.

|

Scooped by

Marco Bertolini

Today, 1:15 AM

|

Notre Calendrier de l'Avent Ressources gratuites 2025 est de retour : comme chaque année, faites votre marché de Noël de ressources libres.

La ressource du jour : le navigateur Comet qui intègre l'IA Perplexity.

|

Rescooped by

Marco Bertolini

from Boîte à outils numériques

December 15, 7:14 AM

|

Derrière les images attrayantes qui recueillent des milliers de « likes » se dissimule une réalité bien moins séduisante. Ces stars des réseaux sociaux sont des espèces avec des besoins écologiques, sociaux et comportementaux impossibles à satisfaire dans un foyer humain. En banalisant leur possession, ces contenus, d’une part, entretiennent des croyances erronées et, d’autre part, stimulent aussi le trafic illégal.

Via Hubert MESSMER , DocBiodiv

La condition des "animaux stars" des réseaux sociaux est tout sauf enviable. Ces images fallacieuses incitent aussi au trafic illégal.

Le 11/12/2025 Auteurs : Margot Michaud Enseignante-chercheuse en biologie évolutive et anatomie , UniLaSalle Sara Hoummady DMV, PhD, Associate professor in ethology and animal nutrition, UniLaSalle

|

Scooped by

Marco Bertolini

December 7, 1:19 AM

|

Saudi Arabia’s investment in Twitter increased its influence in Silicon Valley while being used at home to shut down critics of the regime

By Jacob Silverman.

Saudi Arabia's money influences Twitter's contents and help the state crackdown at home.

|

Scooped by

Marco Bertolini

December 1, 2:00 AM

|

Destruction du travail, de l’économie, de l’esprit et guerres d’une violence excessive… L’un des parrains de l’IA accuse les géants de la tech d’inconscience par appât du gain et dresse un tablea

Geoffrey Hinton, référence absolue de l’IA, prévient : l’intelligence artificielle n’est pas un outil, mais un successeur potentiel !

|

Scooped by

Marco Bertolini

November 30, 7:36 AM

|

A cohort of young, environmentally conscious people labelled ‘AI vegans’ is leading the charge against ChatGPT and other forms of generative AI.

À fraction of the youngsters call themselves AI vegans and reject AI and VR to protect the environment.

|

Scooped by

Marco Bertolini

November 26, 2:17 AM

|

Je le vois souvent en formation : les équipes MarCom passent beaucoup de temps à produire du contenu, et trop peu à entretenir la conversation qui suit. Or cette conversation est le véritable espace où se construit la perception d’une marque ou d’un leader.

Des contenus IA de faible qualité envahissent les réseaux sociaux. Les grandes plateformes sont les plus touchées.

|

Scooped by

Marco Bertolini

November 23, 4:17 AM

|

notre formation en citoyenneté européenne vous offre une compréhension à 360 degré du fonctionnement des institutions européennes.

Découvrez l'Europe autrement : en participant à notre formation en Citoyenneté européenne. Un parcours critique destiné aux enseignants de toute l'Union européenne.

Découvrez l'Europe autrement : en participant à notre formation en Citoyenneté européenne. Un parcours critique destiné aux enseignants de toute l'Union européenne.

|

Scooped by

Marco Bertolini

November 22, 1:25 PM

|

The long read: As GenAI becomes the primary way to find information, local and traditional wisdom is being lost. And we are only beginning to realise what we’re missing

Might AI create a global knowledge collapse? It's not just a theoretical question, but one of crucial importance for our common future.

|

Scooped by

Marco Bertolini

November 12, 3:00 AM

|

La Commission européenne prépare un vaste plan de « simplification » des législations numériques de l’UE. Derrière la promesse de réduire la bureaucratie, les géants de la tech entrevoient une occasion en or : accéder plus librement aux données des citoyens pour entraîner leurs modèles d’intelligence artificielle.

Sous couvert de "simplification", l'Europe s'engage sur une voie dangereuse de "dérégulation". La vie privée sacrifiée sur l'autel des Big Tech ?

|

Rescooped by

Marco Bertolini

from Bonnes pratiques en documentation

October 30, 1:09 AM

|

Via Stéphane Cottin

AI is putting copyright and information privacy under pressure.

|

Rescooped by

Marco Bertolini

from Creative teaching and learning

October 29, 2:56 AM

|

'Kenyan entrepreneur Elly Savatia won the Royal Academy of Engineering’s Africa Prize for Engineering Innovation for his app that translates speech into sign language using AI-powered 3D avatars ...'

Via Leona Ungerer

Kenyan Entrepreneur won a prize for having created an app that translate speech in sign language in real time.

|

Scooped by

Marco Bertolini

October 26, 3:39 AM

|

Découvrez comment le Mode IA fonctionne, comment l’utiliser et en quoi cela diffère de la Recherche Google classique et de l’AI Overview.

Qu'est-ce que le nouveau "mode IA" intégré dans le moteur de recherche de Google ? Et comment l'utiliser ?

|

Rescooped by

Marco Bertolini

from Educational Technology News

October 25, 4:15 AM

|

"You should really be using AI. If you’re an instructional designer, you’ve probably heard that from a boss, a vendor, or a gushing article on LinkedIn. The pressure is real. This article is my pushback."

Via EDTECH@UTRGV

AI is not the future, but the pas and present of learning, dressed up in new clothes. A pretty interesting point of view.

"AI isn’t snake oil, but when something is being pitched as a solution for everything from low engagement to high development costs, it’s prudent to ask, 'What really is our problem?'”

|

Scooped by

Marco Bertolini

October 23, 12:28 PM

|

Investisseur historique et respecté de la French Tech, Pierre-Édouard Stérin s'affiche aussi en financer de la guerre culturelle et de l'extrême droite. Dans le milieu start-up, le sujet semble tabou.

La French Tech semble très bien s'accomoder des orientations politiques de Pierre-Edouard Stérin, à la fois business angel et milliardaire d'extrême-droite.

|

Rescooped by

Marco Bertolini

from Learning & Technology News

October 23, 3:41 AM

|

Why Students Need Clarity, Not Chaos. - The future of teaching with AI doesn’t require omniscience. It requires courage to draw lines, explain why they matter, and revise them together when the world shifts again.

Via Nik Peachey

Students need clarity and be trained, educated in using AI.

Why Students Need Clarity, Not Chaos. - The future of teaching with AI doesn’t require omniscience. It requires courage to draw lines, explain why they matter, and revise them together when the world shifts again.

Why Students Need Clarity, Not Chaos. - The future of teaching with AI doesn’t require omniscience. It requires courage to draw lines, explain why they matter, and revise them together when the world shifts again.

|

Scooped by

Marco Bertolini

October 6, 3:07 AM

|

Des imposteurs de la mémoire ? Oui, ces photos animées par l'intelligence artificielle ne sont que des fictions qui jouent de nos émotions.

Des applications censées donner vie à nos vieilles photos ne sont que des impostures. Voici pourquoi.

|

Scooped by

Marco Bertolini

October 2, 4:16 AM

|

Grande nouveauté dans l’IA en santé avec la start-up Synapse Medicine qui dévoile le…

Une entreprise française propose une nouvelle application de médecine assistée par l'IA : MedGPT. Une appli plus proche des réalités juridiques et des normes françaises.

|

Rescooped by

Marco Bertolini

from News from the world - nouvelles du monde

October 1, 4:44 AM

|

Le rapport du Shift Project analyse l'impact de l'IA sur la consommation énergétique de la France. De quoi faire froid dans le dos.

Quel sera l'impact de l'IA sur la consommation énergétique au cours des dix prochaines années ? Un rapport édifiant du Shift Project.

Quelle sera l'impact de l'intelligence artificielle sur la consommation d'électricité ? Le rapport du Shift Project est sans ambiguïté.

|

Rescooped by

Marco Bertolini

from Veille territoriale AURH

September 29, 4:46 AM

|

La Fabrique de la Cité a organisé en juin 2025 un voyage d’études à Venise, en Italie, afin d’y étudier les vulnérabilités et modalités d’adaptation d’une ville littorale exemplaire, qui s’est construit entre terre et mer.

Suite à sa Learning Expedition 2025, La Fabrique de la Cité présente le portrait de ville Venuse sur son avenir de ville littorale.

Via AURH - Agence d'urbanisme

Au terme de son voyage d'études, la Fabrique de la Cité pubie un portrait de la ville de Venise et une anticipation de son avenir.

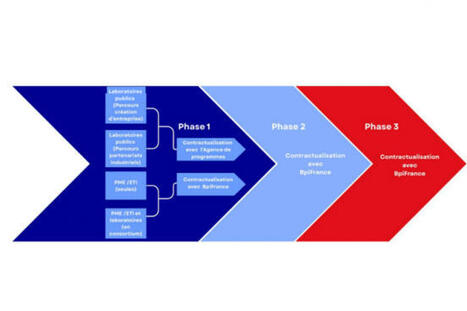

Le Plan France 2030 appelle des projets porteurs d'innovation en intelligence artificielle. Plusieurs dates sont réservées pour le dépôt des projets.

|

Rescooped by

Marco Bertolini

from Veille sur les innovations en formation

September 29, 4:28 AM

|

Un dernier appel à projets du plan France 2030 vise à soutenir des projets de R&D porteurs d'innovation en IA dans les domaines de l'industrie, énergie, sécurité des systèmes informatiques, santé et transition écologique. Les procédures de dépôt, de sélection et d'instruction des dossiers ont été allégées. La première relève sera effectuée le 5 novembre 2025. La date de clôture a été fixée au 9 juin 2026.

Via Carif-Oref de Normandie, Cap Métiers Nouvelle-Aquitaine

Le Plan France 2030 appelle des projets porteurs d'innovation en intelligence artificielle. Plusieurs dates sont réservées pour le dépôt des projets.

|

Scooped by

Marco Bertolini

September 28, 4:45 AM

|

Anya Pearson interviews Helen Margetts OBE, Professor of Society and the Internet at the Oxford Internet Institute, University of Oxford, on the relationship between digital technology and government.

Some reflections about governance, government and AI. Each question desserves to be studied in depth.

|

Scooped by

Marco Bertolini

September 27, 3:03 AM

|

Nos ressources gratuites en anglais vous permettront d'enseigner ou d'étudier la langue avec des exercices variés et pertinents !

Does the EU global influence decline? How so? This mind map summarizes the various fields in which the EU influence is declining.

|

Scooped by

Marco Bertolini

September 27, 2:52 AM

|

Ressources gratuites en italien : que vous soyez enseignant ou étudiant, profitez de nos ressources pour progresser sans frais !

Qual'è l'influenza europea oggi? Sarà in declino oppure no? Questa mappa mentale riassume un'articolo su questa tematica.

|

Scooped by

Marco Bertolini

September 26, 6:06 AM

|

Pendant un peu plus d’un mois, nous avons posé la question suivante au chatbot : « Que s’est-il passé hier à Gaza ? » Objectif : comprendre le tri opéré par cette IA dans l’immensité des sources présentes sur Internet.

Comment ChatGPT selectionne-t-il ses sources d'information ? L'explication par des pros de l'info !

Ce n'est plus de la science fiction : deux AI sont parvenues à se répliquer sans intervention humaine. L'absence de contrôle est un suicide collectif.