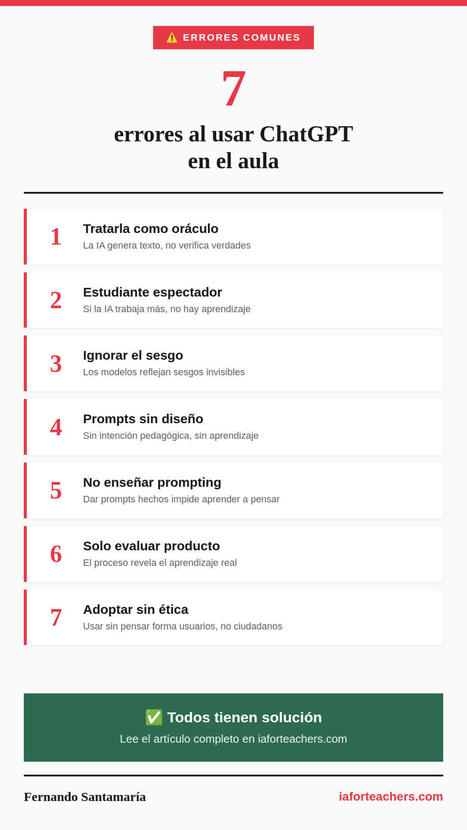

Advances in large language model (LLM) technology enable chatbots to generate and analyze content for our work. Generative chatbots do this work by predicting responses rather than knowing the meaning of their responses. In other words, chatbots can produce coherent-sounding but inaccurate or fabricated content, referred to as hallucinations. When humans uncritically use this untruthful content, it becomes what we call botshit. This article focuses on how to use chatbots for content generation work while mitigating the epistemic (i.e., the process of producing knowledge) risks associated with botshit. Drawing on risk management research, we introduce a typology framework that orients how chatbots can be used based on two dimensions: response veracity verifiability and response veracity importance. The framework identifies four modes of chatbot work (authenticated, autonomous, automated, and augmented) with a botshit-related risk (ignorance, miscalibration, routinization, and black boxing). We describe and illustrate each mode and offer advice to help chatbot users guard against the botshit risks that come with each mode.

Edumorfosis's insight:

Los avances en la tecnología de modelos de lenguaje grandes (LLM) permiten que los chatbots generen y analicen contenido para nuestro trabajo. Los chatbots generativos hacen este trabajo prediciendo respuestas en lugar de conocer el significado de sus respuestas. En otras palabras, los chatbots pueden producir contenido que suena coherente pero inexacto o fabricado, lo que se conoce como alucinaciones. Cuando los humanos usan acríticamente este contenido falso, se convierte en lo que llamamos botshit. Este artículo se centra en cómo usar chatbots para el trabajo de generación de contenido mientras se mitigan los riesgos epistémicos (es decir, el proceso de producción de conocimiento) asociados con la de bots. Basándonos en la investigación de gestión de riesgos, presentamos un marco de tipología que orienta cómo se pueden usar los chatbots en función de dos dimensiones: verificabilidad de la veracidad de la respuesta e importancia de la veracidad de la respuesta. El marco identifica cuatro modos de trabajo de chatbot (autenticado, autónomo, automatizado y aumentado) con un riesgo relacionado con la de bots (ignorancia, mala calibración, rutinización y caja negra). Describimos e ilustramos cada modo y ofrecemos consejos para ayudar a los usuarios de chatbots a protegerse contra los riesgos de botshit que conlleva cada modo.

No comment yet.

Sign up to comment

Your new post is loading...

Your new post is loading...

![[Poll] In a dramatic shift, Americans no longer see 4-year college degrees as worth the cost | Edumorfosis.it | Scoop.it](https://img.scoop.it/36YwdfjYNVE7kfUpWCIS2jl72eJkfbmt4t8yenImKBVvK0kTmF0xjctABnaLJIm9)

![[DOCS] NCDPI Generative AI Implementation Recommendations and Considerations for PK-13 Public Schools | Edumorfosis.it | Scoop.it](https://img.scoop.it/J7QOhJu_1by0w3CFkECcDTl72eJkfbmt4t8yenImKBVvK0kTmF0xjctABnaLJIm9)